投稿:益田、取越

紹介

今回は中村教授のアニメ系アバターとおまけでリアル系アバターの制作を行ったので紹介します。

機材・環境

- Perception neuron2.0 (モーションキャプチャー有線)

- Perception neuron Pro (モーションキャプチャー無線)

- Oculus riftS(VR観賞用)

- 動作PC(win10,i7-9750H,GTX 1660Ti 6GB,32GB)

- 動作PC(win10,i7-,GTX1050Ti,64GB)x2

- 開発PC(win10,i7-9700K,RTX2070super,64GB)

- Unity2019,4,16/2019,4,14(開発ソフト)

- VRM Unityパッケージ

- Cluster Creator Kit Unityパッケージ

- Perception neuron Unityパッケージ

- Maya2020(モデリング)

- VRoid (アバター制作)

- NDI tool

- StructureSensor(ipad用スキャナー)

- AXISNeuronPRO(モーションデータ処理)

- TriCaster460(合成・送出)

背景

普通のビデオ会議では飽きてきたので新しいことはできないのか?

単に人がしゃべるよりも面白いことはできないか?

新しいコミュニケーションツールとして制作することにしました!

アニメ系アバター制作編

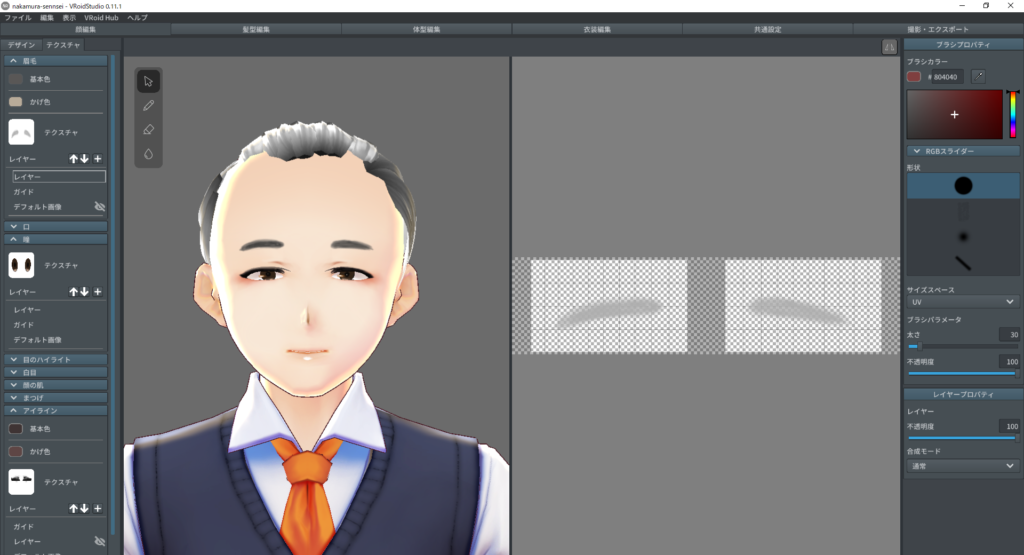

1.顔

顔が正面から写っている写真を参考に目の幅や瞳の大きさ、眉と目の間隔等をパラメーターをいじって調節します。

ざっくり似てきたらテクスチャ画面に移動して、デフォルト画像とUVのガイドを元に瞳・アイライン・眉を書きます。

今回は眉以外はデフォルト画像の色味を変えたり削ったりして作成しています。

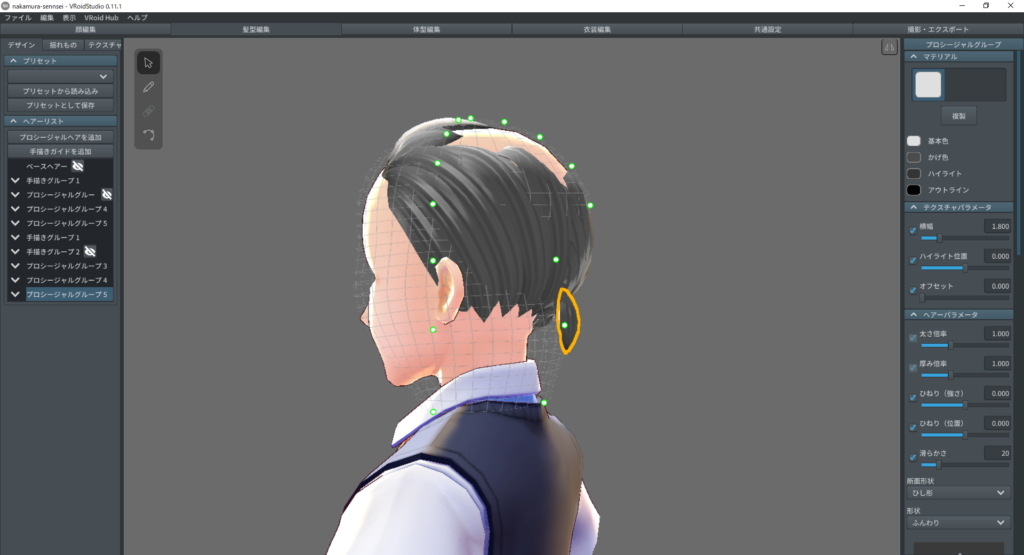

2.髪

顔がある程度できたら髪の毛を生やしていきます。

プロシージャルヘアを使ってサイドの髪の毛を生成します。

そのあと手書きレイヤーを追加して頭頂部の髪を追加。

忘れそうになっていた一つ結びされた髪の毛もプロシージャルヘアで作成。

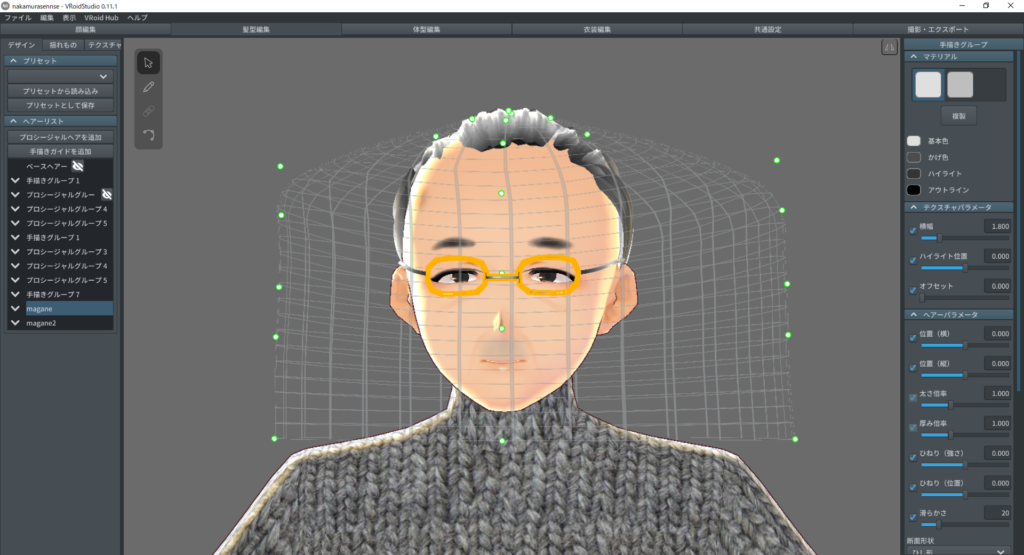

3.肌と眼鏡

肌の色をデフォルトより黒く変更。顔のしわなども書き足します。

なにかが物足りないな…と思ったら眼鏡を作っていなかったので手書きした髪の毛パーツをミラー適用した状態でいじり、左右対称な眼鏡を作ります。

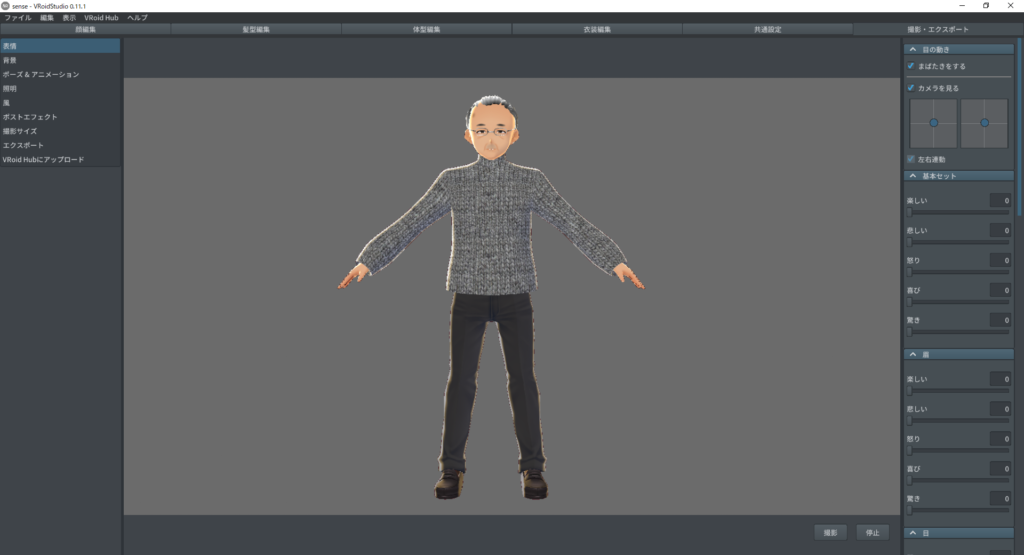

4.服と体形

ニットにしよう!ということで初期実装のロングコートのUVを使用してハイネックニットを作ります。フリーテクスチャ様様。

リアル系アバターの写真とこのアニメ系アバターを並べて見比べながら足の長さなどを調整。

ついでに肌の色ももう少し濃くして完成です。ヤッター

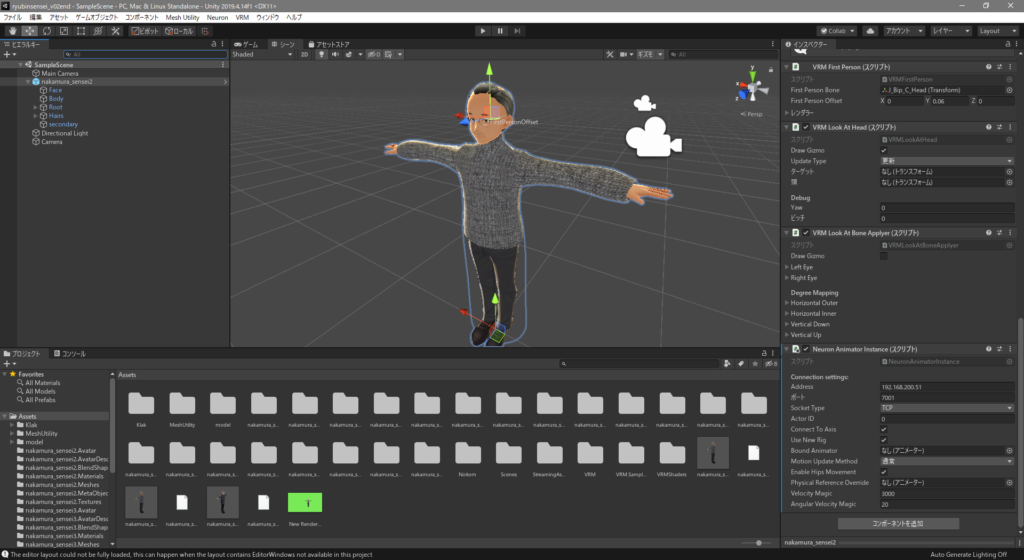

5.モーションキャプチャー連携

Unityに制作したアバターデータをインプットしていきます。

※Unity標準ではVRMを読み込めないのでパッケージインストール必須です。Unityバージョンによってはうまく作動しないことがあるので注意してください。

- モーションキャプチャー Unityパッケージ

https://neuronmocap.com/software/unity-sdk - Unity VRMパッケージ

https://github.com/vrm-c/UniVRM/releases

リアル系アバター制作編

1.3Dスキャン

StructureSensor(ipad用スキャナー)とiPadPro第2世代LiDARで3Dスキャンをしていきます。

顔や手のように複雑な形状は一気にスキャンせずにパーツごとで行うことで精度が上がります。

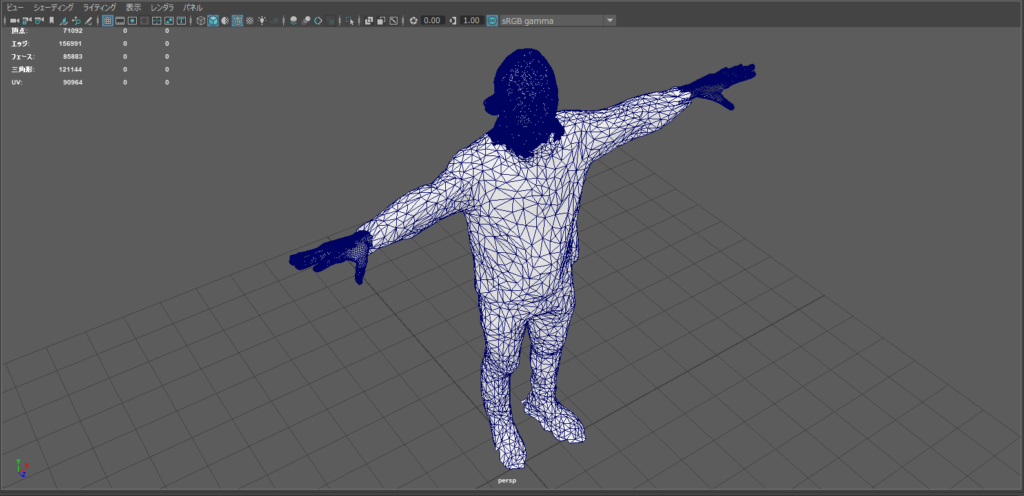

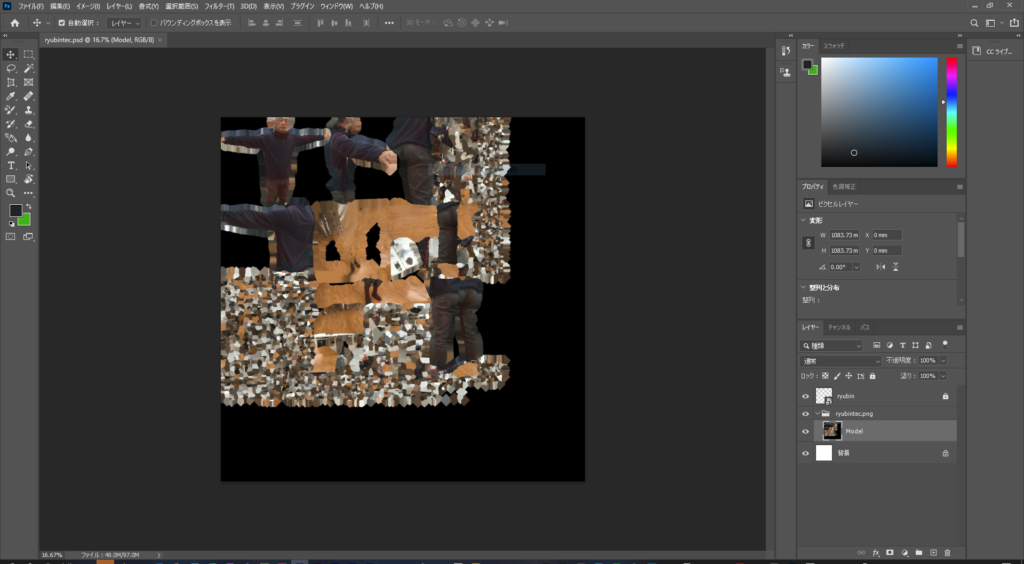

2.モデル補正

3Dスキャンできず穴が空いている部分の補正やテクスチャ補正を行います。

顔や手は形状が複雑で一括スキャンは困難なので部分的にスキャンして合成です。

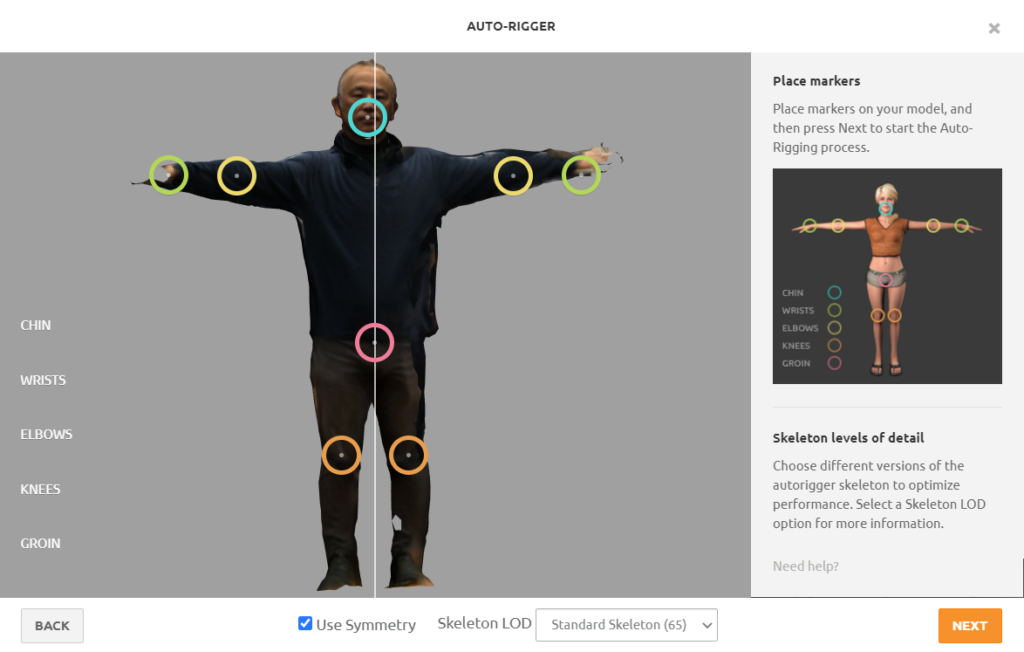

3.リグ入れ

Adobe Mixamoを使うことで手間のかかるリグ入れとウェイトペイントを省略することができました。(数分で終わります…)

これまでの作業工程が悲しくなってきますね…

mixamoにはサンプルモーションがあるのでこんなこともできる!

いろんな動きを付けれますね笑

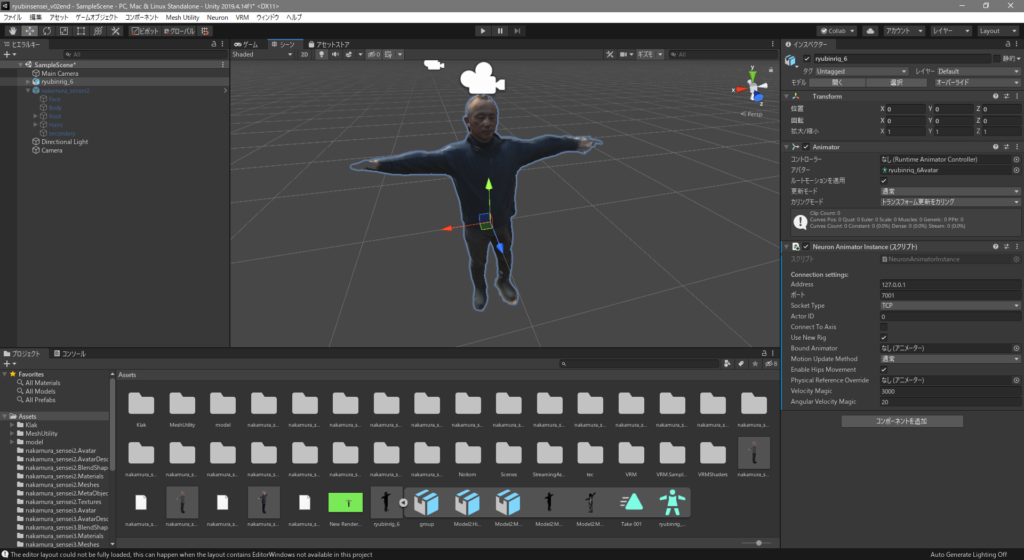

4.モーションキャプチャー連携

Unityに制作したアバターデータをインプットしていきます。

※アバターリグのアニメーションタイプをヒューマノイドに設定することを忘れずに!

- モーションキャプチャー Unityパッケージ

https://neuronmocap.com/software/unity-sdk

「さだいさんぽ!」コラボ

「さだいさんぽ!」のワールドデータとアバターをUnity上でコラボさせることでVR空間で楽しむことができます。

Cluster Creator Kitを使うことで簡単に制作できました。

- Oculus Unityパッケージ

https://assetstore.unity.com/packages/tools/integration/oculus-integration-82022 - Cluster Creator Kit Unityパッケージ

https://clustervr.gitbook.io/creatorkit/

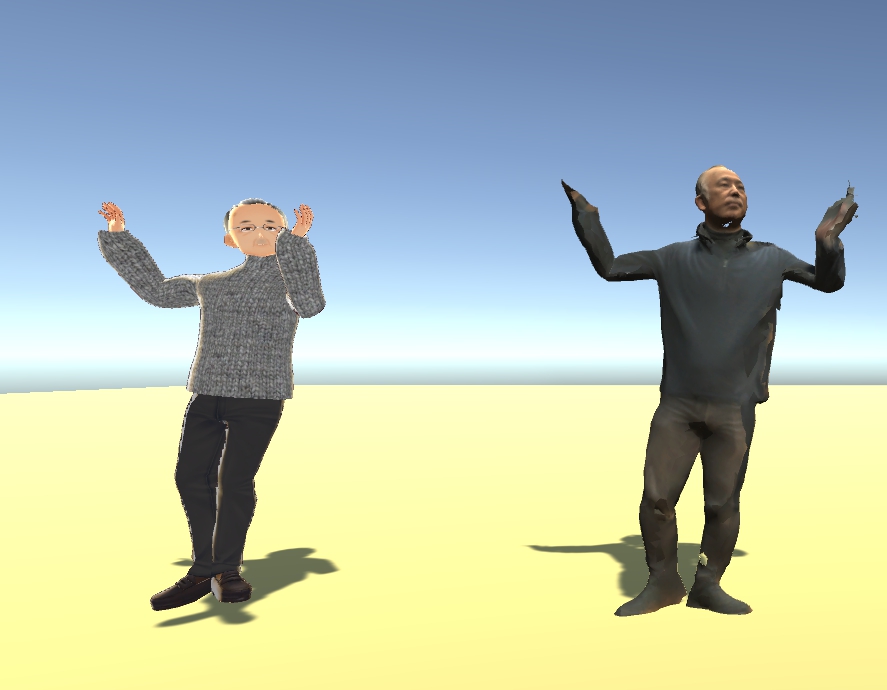

合成してみると・・・

リアルMCと合成で対談もやってみました!